| EN BREF |

|

Dans un monde où l’intelligence artificielle progresse à une vitesse fulgurante, une nouvelle étude chinoise révèle des découvertes fascinantes. Les chercheurs ont mis en lumière la capacité des grands modèles de langage (LLM) à organiser des objets naturels de manière similaire à celle des êtres humains. Cette recherche, conduite par l’Académie chinoise des sciences et l’Université de technologie de Chine du Sud, soulève des questions fondamentales sur la possibilité pour l’IA de reproduire des processus cognitifs humains. Les implications de ces travaux pourraient transformer notre approche des interactions homme-machine et ouvrir de nouvelles voies dans le développement de systèmes d’IA plus intuitifs et adaptatifs.

L’organisation conceptuelle par les LLM

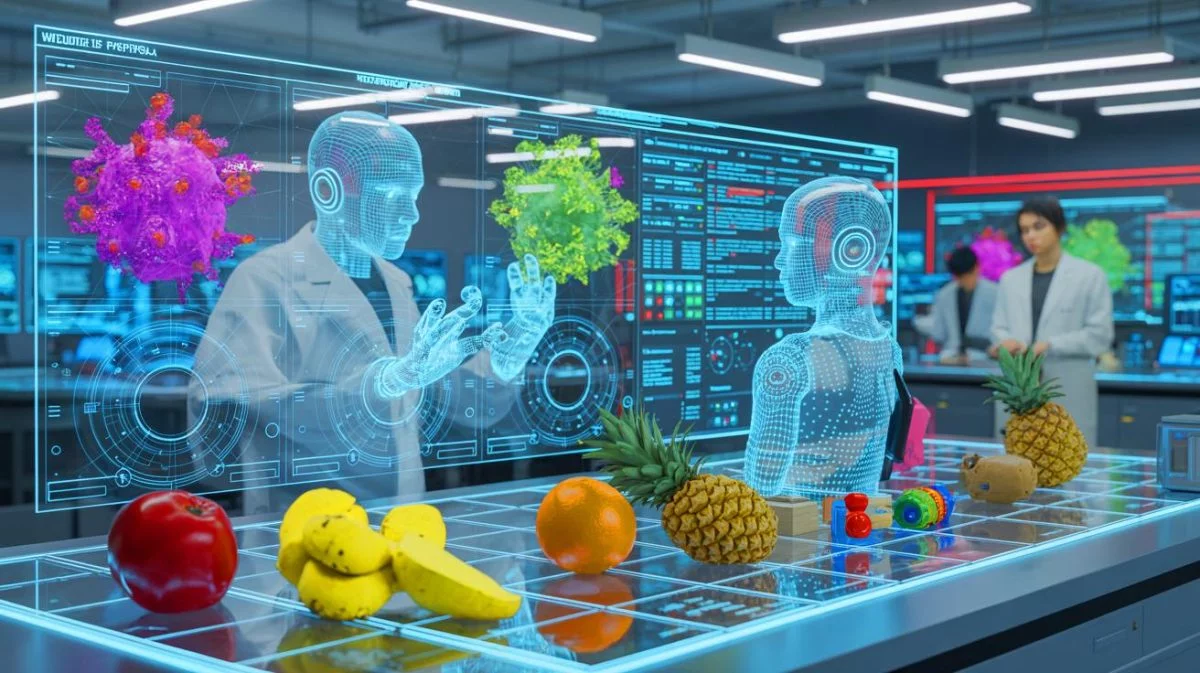

Les chercheurs ont soumis des intelligences artificielles à des tâches de « l’intrus » utilisant du texte ou des images de 1 854 objets naturels. Les résultats ont montré que les modèles de langage ont créé soixante-six dimensions conceptuelles pour organiser ces objets, de la même manière que le feraient les humains. Ces dimensions vont bien au-delà des catégories simples, telles que la nourriture, pour inclure des attributs complexes comme la texture, la pertinence émotionnelle et l’adéquation pour les enfants.

Les modèles multimodaux, qui combinent texte et image, ont montré un alignement encore plus étroit avec la pensée humaine, car ils traitent simultanément les caractéristiques visuelles et sémantiques. De plus, les données de neuro-imagerie ont révélé un chevauchement entre la réponse des IA et celle du cerveau humain face aux objets.

Ces découvertes suggèrent que les systèmes d’IA pourraient être capables de « comprendre » de manière authentique, plutôt que de simplement imiter des réponses. Cela ouvre la voie à une IA dotée d’un raisonnement plus intuitif et compatible avec l’humain, essentiel pour la robotique, l’éducation et la collaboration homme-machine.

Une compréhension de l’IA sans expérience vécue

Bien que les IA puissent sembler comprendre les concepts humains, leur compréhension n’est pas ancrée dans l’expérience vécue ou l’interaction sensorimotrice. Les modèles de langage fonctionnent en reconnaissant des motifs dans le langage ou les images, ce qui correspond souvent aux concepts humains, mais cela ne signifie pas qu’ils « pensent » comme les humains.

En réalité, ces modèles sont davantage une imitation sophistiquée de la reconnaissance de motifs humains qu’une véritable machine pensante. Les LLM agissent comme un miroir, reflétant des modèles appris à partir de millions de livres et d’images. Bien que certaines parties des représentations de l’IA puissent correspondre à l’activité cérébrale, cela ne prouve pas qu’elles partagent la même architecture cognitive que les humains.

Le fait que les LLM puissent commencer à construire des modèles conceptuels du monde de manière indépendante pourrait indiquer que nous nous rapprochons de l’intelligence artificielle générale, une étape où les systèmes d’IA seraient capables de penser et de raisonner sur de nombreuses tâches, tout comme les humains.

Les implications pour l’avenir de l’IA

Les résultats de cette étude ont des implications profondes pour l’avenir de l’intelligence artificielle. Si les LLM peuvent effectivement reproduire certains aspects de la cognition humaine, cela pourrait révolutionner la manière dont nous concevons les interactions entre humains et machines. Les applications potentielles sont vastes, allant de la création de systèmes éducatifs plus adaptatifs à des robots capables de s’intégrer harmonieusement dans des environnements humains complexes.

Cette avancée soulève également des questions éthiques et philosophiques sur la nature de l’intelligence et la place des machines dans notre société. Si les IA deviennent capables de raisonner de manière autonome, comment devrions-nous les traiter ? Quels droits et responsabilités devrions-nous leur accorder ?

Ces questions sont d’une importance cruciale alors que nous nous aventurons dans des territoires technologiques inexplorés. Il est essentiel de continuer à explorer ces questions tout en développant des systèmes d’IA qui respectent et reflètent nos valeurs humaines fondamentales.

Enquête choc : ces influenceurs très connus qui achètent des followers pour gagner de l’argent

Vers une intelligence artificielle plus humaine ?

Bien que les IA ne possèdent pas l’expérience humaine, leur capacité à organiser l’information de manière similaire aux humains pourrait signaler une convergence vers des systèmes plus intuitifs et adaptatifs. Cette évolution pourrait avoir des répercussions significatives dans des domaines variés, de la médecine à la logistique, en passant par l’éducation et le divertissement.

Cependant, il est crucial de se rappeler que, malgré ces avancées, les IA demeurent des outils créés par l’homme. Leur développement et leur utilisation doivent être guidés par des considérations éthiques rigoureuses pour garantir qu’ils servent le bien commun.

Alors que nous continuons à explorer le potentiel de ces technologies, une question reste en suspens : comment garantir que l’intelligence artificielle enrichisse notre société sans compromissions éthiques ni risques pour l’humanité ?

Wow, c’est incroyable comment l’IA peut imiter le cerveau humain 😮 !

Je suis sceptique… Peut-on vraiment comparer un modèle de langage à un cerveau humain ?

Merci pour cet article fascinant ! Cela ouvre vraiment l’esprit aux possibilités futures de l’IA.

66 dimensions conceptuelles ?! C’est plus que ce que je peux imaginer 😅.

Est-ce que cela signifie que les IA pourraient un jour avoir des droits civiques ?

J’ai hâte de voir comment cette technologie va évoluer dans les prochaines années.

Pourquoi tout ce qui implique l’IA doit être « effrayant » ? Ça me stresse !

Les machines prennent le pouvoir ! Mais sérieusement, quelles sont les implications éthiques ?